E’ possibile una Governance e un Controllo dell’AI?

La governance è una parola complicata e un po’ fumosa perché essa include tutti i processi di governo aziendali. È il modo in cui le regole o le azioni sono strutturate, mantenute e regolamentate compreso il modo in cui viene assegnata la responsabilità. La governance dell’AI implica che l’AI è spiegabile, trasparente ed etica. Queste tre parole significano cose diverse per organizzazioni diverse o funzioni all’interno delle stesse.

Una politica di governance deve esistere, essere comunicata e deve interagire con il mondo che la circonda con l’organizzazione ed il suo interno. La governance dell’AI deve adattarsi al quadro generale della governance aziendale.

In generale, la governance AI include tutti i processi di governance: il modo in cui le regole o le azioni sono strutturate, mantenute e regolamentate e come sia attribuita la relativa responsabilità.

Possiamo riassumere tre aspetti che sintetizzano gli aspetti di Governance

- Le Misure: la capacità di misurare costi, valore, verificabilità e conformità.

- I Software e i Dati: i dettagli sul codice software e sui singoli componenti dei dati.

- Il Quadro Aziendale: la necessità di adattarsi al quadro generale di governo dell’organizzazione

Un aiuto sulla metodologia e sulla Governance AI ci viene dalla norma ISO 38507: Information technology — Governance of IT — Governance implications of the use of artificial intelligence by organizations, ad oggi in versione FDis

Infatti, scopo del documento è quello alle implicazioni per un’organizzazione dell’uso dell’AI. Come con qualsiasi strumento potente, l’uso dell’IA comporta nuovi rischi e responsabilità che dovrebbero essere affrontati dalle organizzazioni che la utilizzano. L’I non è intrinsecamente “buona” o “cattiva”, “giusta” o “parziale”, “etica” o “non etica”, sebbene il suo uso possa essere o possa sembrare tale.

Lo scopo dell’organizzazione, l’etica e altre linee guida si riflettono, formalmente o informalmente, nelle sue politiche. La norma esamina sia le politiche di governance che quelle organizzative e la loro applicazione e fornisce indicazioni per adattarle all’uso dell’AI. Il documento fa riferimento ad altri standard per i dettagli su argomenti correlati, tra cui la responsabilità sociale, l’affidabilità (come la gestione del rischio, la gestione dei pregiudizi e la qualità) e la gestione della conformità.

I capitoli principali riguardano:

- Governance e sue implicazioni (governance e accountability);

- Una visione dei Sistemi AI (tipi di tecnologie e ecosistema);

- Le politiche per indirizzare l’uso dell’AI (cultura, valori, rischi, etc.).

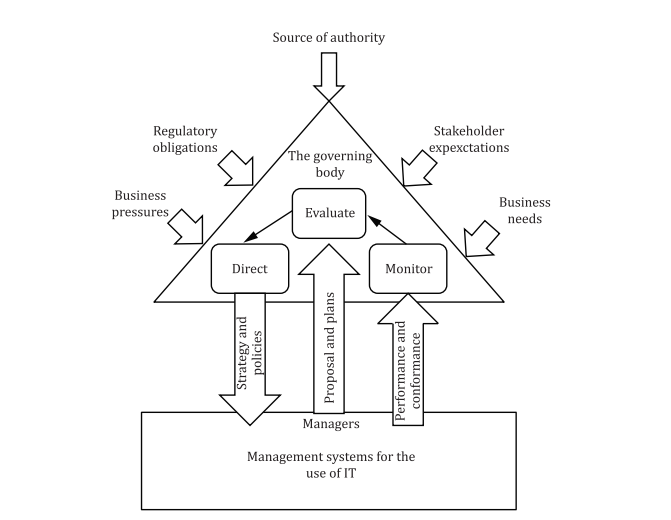

La figura riporta il modello di Governance indicato dalla norma citata.

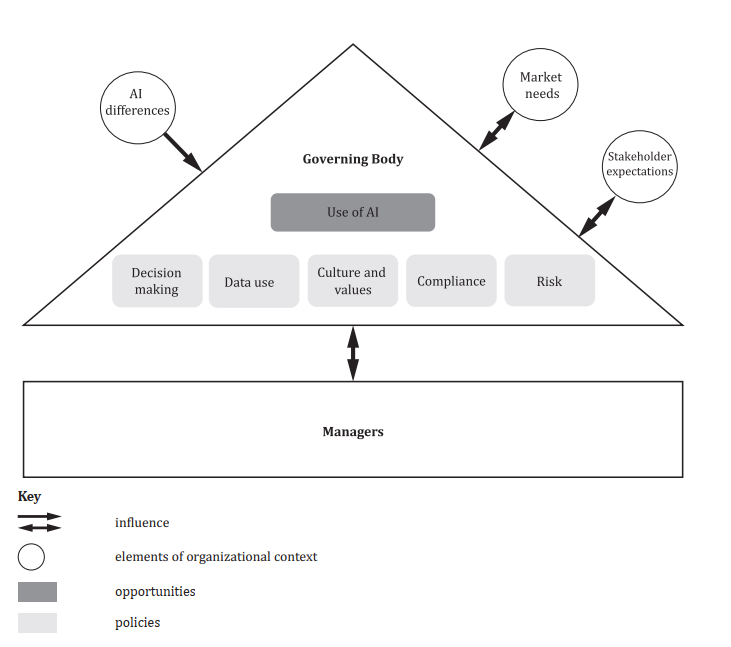

La figura seguente illustra la Governance delle implicazioni dell’uso dell’AI.

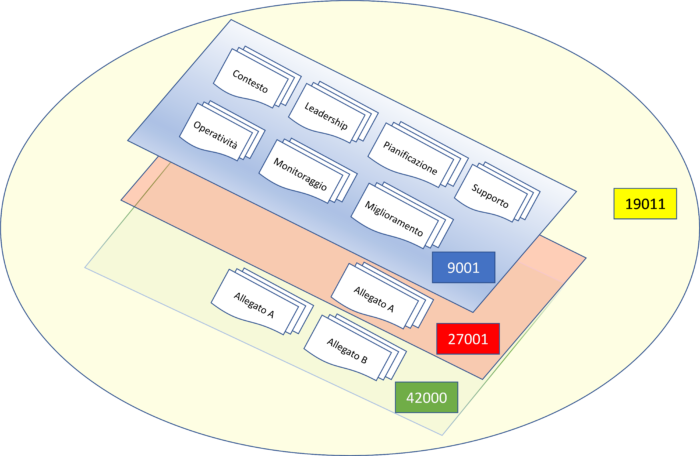

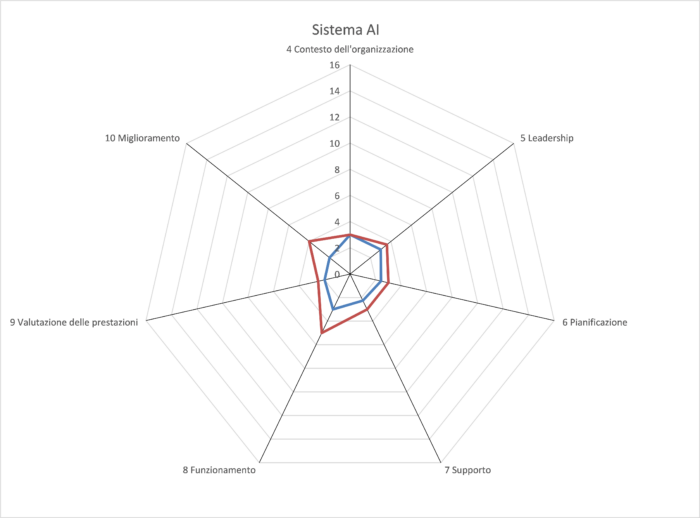

La Governance è parte integrale dei processi decisionali della Direzione aziendale e deve essere supportata da un sistema di gestione che ne garantisca l’applicazione e la conformità. Anche in questo caso, un supporto viene dalla norma ISO 42001 Information technology — Artificial intelligence -Management system, come anche riportato nell’articolo pubblicato a maggio 2022 del quale riportiamo il link: https://www.ictsecuritymagazine.com/articoli/la-governance-dellai-attraverso-le-norme-iso/ del quale riportiamo un’immagine riassuntiva.

Infatti, la figura sopra riportata richiama un sistema di gestione di un’organizzazione, che attraverso dei processi formali e documentati, guida l’organizzazione e la sua Direzione all’implementazione di un approccio strutturato per processi.

Ma l’implementazione e l’applicazione di un sistema di gestione non sono sufficienti se non intervengono processi di controllo che permettono all’azienda di avere una chiara visione dei risultati delle attività e del polso della situazione. Nella figura sopra viene citata la norma ISO 19011 relativa agli audit di sistema. Anche nell’ambito dell’AI è necessario individuare dei sistemi di controllo, sia degli input che degli output, del processo e della metodologia utilizzata.

Come ogni sistema di gestione certificabile, così sarà anche per la ISO 42001, è necessario che gli organismi di certificazione adottino un sistema di gestione della conformità. Ecco che è in fase di discussione la norma ISO 42006 Information technology — Artificial intelligence — Requirements for bodies providing audit and certification of artificial intelligence management systems.Norma che introduce ulteriori requisiti rispetto alla ISO 17021-1.

L’utilizzo di varie metodologie che possono andare dagli audit alle check list, che devono verificare il prima, ovverosia durante la progettazione e i modelli utilizzati che il dopo, cioè il risultato finale permette all’organizzazione di avere il controllo della conformità del progetto e del rispetto dei requisiti.

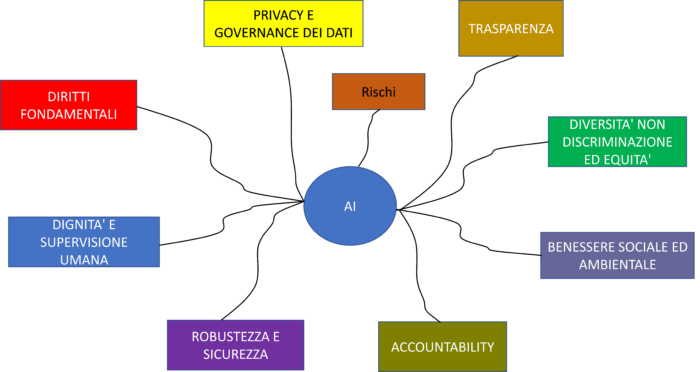

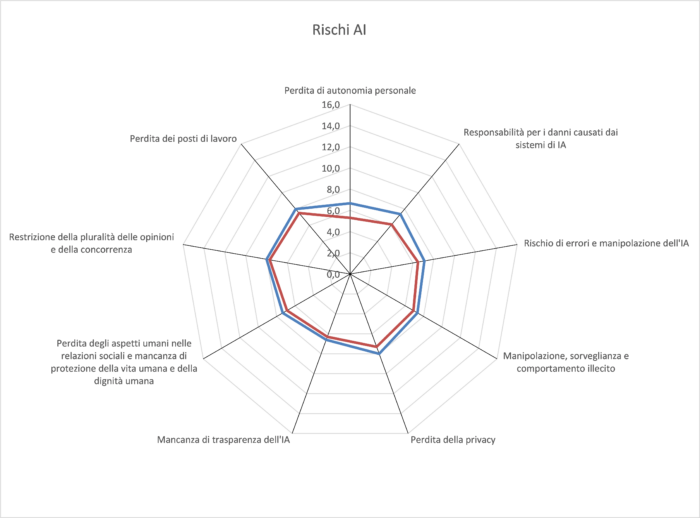

In particolare, gli aspetti da verificare, prima e dopo, possono essere riassunti nella figura seguente.

Attraverso magari tool dedicati, risulta quindi possibile ottenere la fotografia e i risultati pre e post, del modello di AI implementato. Molte volte il risultato atteso non è quello che viene prodotto attivando così una serie di controlli a ritroso per la verifica del processo e dei dati.

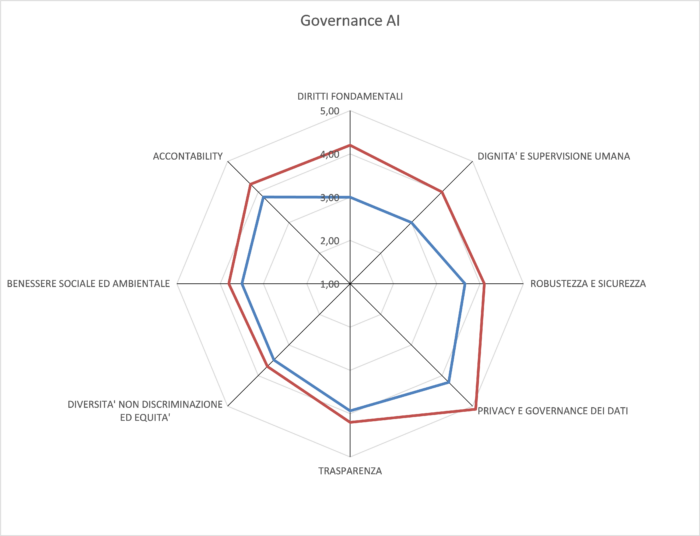

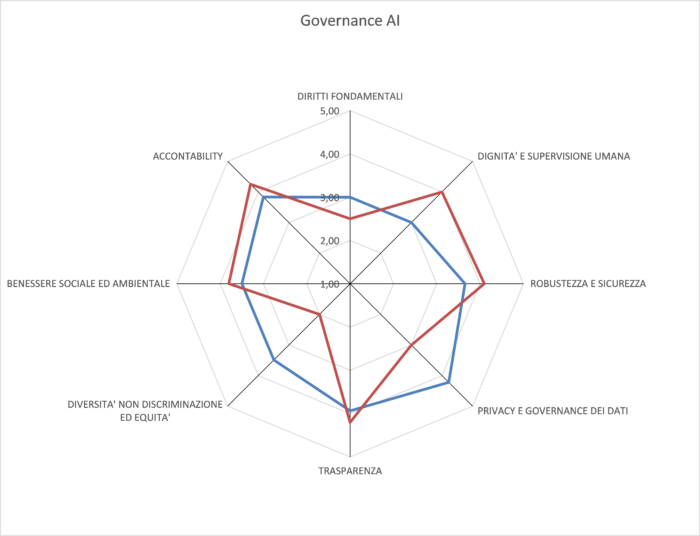

Un esempio è riportato nelle immagini seguenti dove con la linea azzurra si evidenzia la fase di verifica iniziale e con la linea rossa quella finale. Nelle prime immagini, a destra abbiamo un grafico che indica le due situazioni in ottica di miglioramento continuo, mentre in quello a fianco abbiamo l’evidenza che i risultati non sono conformi alle premesse dei requisiti.

Articolo a cura di Stefano Gorla

Privacy & Cybersecurity Manager presso Profice Auditor 27001, 22301, 9001, 20000-1, 50001, 37001, NIST Specialist, DPO, ITILv4, COBIT5, membro commissione UNINFO AI, Membro comitato scientifico ANDIP

https://www.ictsecuritymagazine.com/articoli/e-possibile-una-governance-e-un-controllo-dellai/