Negli ultimi anni l’intelligenza artificiale (AI) ha rivoluzionato il panorama della sicurezza informatica, sia come potente strumento difensivo sia come pericolosa risorsa nelle mani degli attaccanti.

Il concetto di AI avversaria, ovvero l’uso intenzionale dell’intelligenza artificiale per condurre attacchi informatici o sabotare sistemi di difesa automatizzati, sta emergendo come una delle minacce più complesse e insidiose della guerra cibernetica moderna.

L’AI avversaria sfrutta le vulnerabilità intrinseche nei modelli di apprendimento automatico e nei sistemi intelligenti, rendendo possibile la creazione di malware capaci di apprendere e adattarsi in tempo reale alle difese cibernetiche.

Ancora più preoccupante è il suo potenziale nell’alimentare attacchi di ingegneria sociale, permettendo a criminali e attori statali di lanciare campagne di phishing personalizzate e sfruttare tecnologie come i deepfake per creare falsi digitali convincenti.

Nel 2018 IBM svelò un esperimento chiamato DeepLocker, un malware alimentato dall’intelligenza artificiale, progettato per dimostrare come le minacce informatiche AI-driven possano essere quasi invisibili fino al momento dell’attacco. DeepLocker utilizzava modelli di machine learning per nascondere il malware all’interno di applicazioni comuni, attivandolo solo quando riconosceva il bersaglio specifico attraverso input biometrici o altri segnali unici.

L’esperimento dimostrò come gli attacchi basati su AI potessero essere estremamente difficili da rilevare, aumentando esponenzialmente la complessità per i difensori: questo tipo di attacco segna infatti il passaggio dai malware statici a minacce dinamiche, capaci di evolversi e adattarsi a specifici contesti.

Se il crimine informatico ha già raggiunto livelli preoccupanti, il coinvolgimento dell’intelligenza artificiale sta ulteriormente aggravando lo scenario di rischio. Un report del 2020 di Cybersecurity Ventures[1] prevede che il costo globale del crimine informatico raggiungerà i 10,5 trilioni di dollari all’anno entro il 2025.

Gli attacchi alimentati da AI rappresentano una crescente percentuale di queste perdite, con tattiche di phishing avanzate, automazione di botnet e attacchi zero-day potenziati dall’AI; questi attacchi aumentano non solo il costo ma anche la complessità della protezione, richiedendo alle aziende di adottare misure di difesa altrettanto avanzate, come sistemi di anomaly detection AI-driven e tecniche di apprendimento continuo.

Questo articolo esplorerà in dettaglio come l’AI avversaria stia ridefinendo i confini della guerra cibernetica, trasformando il cyberspazio in un campo di battaglia dove l’arma più potente non è il codice malevolo tradizionale ma un’intelligenza artificiale capace di evolvere, adattarsi e sfidare persino i sistemi di difesa più avanzati.

AI avversaria

L’AI avversaria è una forma specifica di intelligenza artificiale progettata (o manipolata) per eludere, confondere o sovvertire i sistemi di difesa cibernetici basati su AI.

Mentre l’intelligenza artificiale è stata a lungo utilizzata per migliorare la sicurezza informatica, l’AI avversaria rappresenta il lato oscuro di questa tecnologia: un modo in cui gli attaccanti possono sfruttare le debolezze e le imperfezioni intrinseche nei modelli di apprendimento automatico.

Tecniche di attacco dell’AI Avversaria

Gli attacchi condotti tramite AI avversaria si basano su diverse tecniche sofisticate, che mirano a compromettere l’integrità dei modelli AI utilizzati per la sicurezza.

Di seguito alcune delle principali tecniche utilizzate dagli attaccanti:

- Evasion Attacks: questi attacchi si basano sulla manipolazione dei dati di input per ingannare i sistemi di difesa AI. Un esempio classico è il malware che, grazie all’introduzione di piccoli cambiamenti nel proprio codice, riesce a sfuggire ai rilevatori basati su AI, che non lo riconoscono come minaccia.

- Data Poisoning: in questa tipologia di attacchi, gli aggressori alterano i dati di addestramento del modello AI per indurlo a prendere decisioni errate. Un sistema di difesa potrebbe, ad esempio, essere addestrato su dati in cui è stato iniettato del codice malevolo che viene classificato erroneamente come benigno.

- Model Stealing: in questo caso gli attaccanti possono tentare di estrarre informazioni sui modelli AI utilizzati dalle organizzazioni, copiandoli o “rubandoli” al fine di replicarli o di sfruttarne le debolezze in attacchi futuri. Ciò consente agli aggressori di conoscere i criteri di rilevamento e creare minacce su misura che riescono a bypassare le difese AI.

Il rischio delle “Black Box”

Una delle caratteristiche che rende l’AI avversaria così pericolosa è la natura “black box” di molti sistemi di intelligenza artificiale.

La mancata trasparenza nel processo decisionale di un modello AI rende infatti difficile, per i difensori, comprendere esattamente come un attacco avversario stia manipolando il sistema; ciò complica la diagnosi e la risoluzione dei problemi, poiché diventa estremamente arduo capire quali dati siano stati compromessi o in che modo il sistema sia stato aggirato.

Minacce cibernetiche alimentate dall’AI

L’uso dell’intelligenza artificiale come arma è ormai una realtà consolidata nel panorama della sicurezza informatica.

Gli attaccanti stanno sfruttando l’AI per sviluppare malware in grado di apprendere e adattarsi, nonché per perfezionare tecniche di ingegneria sociale, rendendo le minacce cibernetiche sempre più difficili da rilevare e prevenire.

Malware che impara e si adatta[2]

Tradizionalmente il malware operava con schemi statici, il che consentiva ai sistemi di sicurezza di rilevarlo analizzando firme note o comportamenti predefiniti.

Con l’introduzione dell’AI il malware è diventato più evoluto, adattandosi dinamicamente per sfuggire ai sistemi di rilevamento.

Polymorphic Malware: questo tipo di malware cambia continuamente il proprio codice superficiale per evitare di essere rilevato dagli antivirus tradizionali. L’introduzione dell’AI ha reso questa tecnica ancora più sofisticata, permettendo al malware di apprendere dalle risposte dei sistemi difensivi e modificare di conseguenza il proprio comportamento.

Malware auto-apprendente: si stanno osservando casi di malware alimentato da AI che impara e si adatta in tempo reale. Ad esempio, una botnet basata sull’AI può monitorare le difese di una rete e modificare i propri metodi di attacco in base ai pattern di difesa rilevati. Questo tipo di malware agisce come un attaccante “intelligente”, in grado di analizzare gli schemi di risposta e ottimizzare le sue tattiche di penetrazione.

AI e Ingegneria Sociale[3]

Gli attacchi di ingegneria sociale sono tra i più efficaci nel compromettere sistemi e infrastrutture; negli ultimi tempi, grazie all’AI, queste tecniche sono diventate ancora più devastanti.

L’intelligenza artificiale permette infatti agli attaccanti di creare messaggi estremamente personalizzati e realistici che ingannano le vittime, sfruttando tecnologie come il natural language processing (NLP).

Phishing personalizzato: l’AI può analizzare enormi quantità di dati personali per creare email di phishing mirate, che risultano quasi indistinguibili da una comunicazione legittima. Secondo recenti analisi, gli attacchi di phishing alimentati da AI sono in grado di raggiungere tassi di successo molto più elevati rispetto ai metodi tradizionali grazie alla capacità di “parlare” come una persona reale. Secondo uno studio condotto da Tessian gli attacchi di phishing di questo tipo hanno tassi di successo che arrivano fino all’80%, molto più alti rispetto ai metodi tradizionali.

Questo perché le AI possono analizzare grandi quantità di dati provenienti da social media, email e altre fonti per creare comunicazioni personalizzate e convincenti: un attacco condotto da un sistema AI può modellare il linguaggio, il tono e persino le tempistiche della comunicazione per sembrare del tutto autentico.

Tale livello di personalizzazione porta a un tasso di apertura delle email di phishing più elevato e rende le tradizionali difese (come i filtri antispam) molto meno efficaci.

Deepfake[4]: i deepfake, alimentati dall’AI, rappresentano una minaccia emergente nell’ingegneria sociale. Video e audio falsi generati tramite AI possono essere usati per impersonare leader aziendali, funzionari governativi o persino familiari, allo scopo di ingannare e manipolare le vittime. Sono ormai numerosi i casi in cui dei truffatori hanno raggirato le vittime imitando la voce di un loro superiore o familiare, talvolta addirittura con videochiamate contraffatte, riuscendo a estorcere ingenti somme di denaro mediante il ricorso al fattore dell’urgenza o alla simulazione di una situazione di pericolo.

Automazione di attacchi complessi

L’AI non solo rende più potenti le tecniche di attacco ma consente anche di automatizzare processi estremamente complessi, come l’esfiltrazione di dati e l’identificazione di vulnerabilità in tempo reale.

Identificazione di vulnerabilità Zero-Day: gli algoritmi di machine learning possono scansionare milioni di linee di codice e infrastrutture per identificare vulnerabilità sconosciute, note come zero-day. L’uso dell’AI per identificare queste debolezze aumenta l’efficacia e la velocità con cui gli attaccanti possono sfruttarle, accelerando il ciclo degli attacchi.

Automazione delle Botnet: le botnet, reti di computer compromessi utilizzate per lanciare attacchi coordinati, sono diventate più potenti grazie all’intelligenza artificiale. Le botnet alimentate dall’AI sono in grado di autorganizzarsi, adattarsi alle condizioni della rete e coordinare attacchi su larga scala senza la necessità di una costante supervisione umana.

AI Avversaria e attacchi su sistemi di Tecnologia Operativa (OT)

Uno degli sviluppi più preoccupanti nell’uso dell’intelligenza artificiale avversaria è il suo potenziale nell’ambito dei sistemi di tecnologia operativa (OT), che includono le infrastrutture critiche come la gestione delle reti elettriche, le fabbriche automatizzate e i veicoli autonomi.

Gli attacchi che prendono di mira questi sistemi non minacciano solo le infrastrutture informatiche, mettendo a rischio anche la sicurezza fisica: un esempio potrebbe essere un attacco AI-driven contro una flotta di veicoli autonomi, in cui un malware sfrutta vulnerabilità nel software di controllo per manipolare il comportamento dei veicoli stessi. Attraverso tecniche come il data poisoning e l’analisi in tempo reale del traffico stradale, ipoteticamente un attaccante potrebbe far deviare interi convogli di macchine autonome, così causando incidenti o arrivando a bloccare intere città.

Nel 2021 la Colonial Pipeline, una delle principali infrastrutture per la distribuzione di carburante negli Stati Uniti, è stata compromessa da un attacco ransomware.

Anche se in questo caso l’attacco non ha coinvolto AI, è stato un chiaro avvertimento del pericolo che rappresentano gli attacchi OT. Se a questi si aggiunge l’uso di AI avversaria, la situazione potrebbe degenerare: l’AI potrebbe automaticamente identificare vulnerabilità nei sistemi di controllo industriale e orchestrare attacchi coordinati su larga scala senza la necessità di supervisione umana.

Questo rende cruciale lo sviluppo di contromisure, come sistemi di difesa autonomi e resilienti, capaci di anticipare e prevenire questi scenari estremi.

L’AI nelle tattiche di guerra cibernetica

L’intelligenza artificiale sta trasformando le tattiche di guerra cibernetica, portando a un nuovo livello di sofisticazione tanto negli attacchi quanto nelle difese.

Attori statali e criminali informatici stanno sfruttando l’AI per ottenere vantaggi strategici nel cyberspazio, utilizzando l’intelligenza artificiale non solo per attacchi su larga scala ma anche per missioni di spionaggio, sabotaggio e destabilizzazione.

L’uso dell’AI da parte degli Stati per offese cibernetiche[5]

Gli Stati rappresentano alcuni degli attori più attivi nell’uso dell’AI avversaria per operazioni offensive.

Le tecnologie alimentate dall’AI vengono utilizzate per lanciare attacchi mirati contro infrastrutture critiche, rubare informazioni sensibili o manipolare sistemi governativi.

Cyberattacchi mirati: gli Stati stanno sviluppando capacità di AI avversaria per compromettere infrastrutture vitali come reti energetiche, sistemi di controllo industriale (ICS) e comunicazioni governative. Ad esempio, algoritmi di machine learning sono impiegati per identificare vulnerabilità in queste infrastrutture e lanciare attacchi mirati che possono destabilizzare intere regioni.

Attacchi coordinati con AI: utilizzando AI avanzata gli Stati possono coordinare attacchi multi-vettore, sincronizzando offensive cibernetiche con altre forme di conflitto (ad esempio, attacchi fisici o disinformazione) per ottenere il massimo impatto. Questo approccio, noto come “guerra ibrida”, si avvale dell’AI per gestire e ottimizzare ogni aspetto dell’attacco in modo più rapido ed efficiente rispetto agli approcci tradizionali.

Spionaggio e sorveglianza alimentati dall’AI

L’AI ha aperto nuove frontiere anche nello spionaggio cibernetico, permettendo agli attori statali di raccogliere e analizzare enormi quantità di dati sensibili in tempi estremamente ridotti nonché di mettere in campo tecniche di sorveglianza sempre più pervasive.

Esfiltrazione di dati su larga scala: gli algoritmi di intelligenza artificiale vengono utilizzati per penetrare reti sicure e rubare dati sensibili senza essere rilevati. L’AI può anche automatizzare l’identificazione dei dati più critici, accelerando l’esfiltrazione e riducendo i tempi di esposizione.

AI e monitoraggio di massa: paesi con regimi autoritari hanno sviluppato sistemi di sorveglianza basati sull’AI per monitorare le comunicazioni e le attività online di grandi gruppi di persone, identificando potenziali dissidenti o minacce alla stabilità del regime. Questi sistemi sfruttano tecniche di apprendimento automatico per analizzare dati provenienti dai social media, telecamere di sicurezza e altre fonti in tempo reale, aumentando notevolmente l’efficacia dello spionaggio.

Sabotaggio digitale e manipolazione delle informazioni

Un altro campo in cui l’AI avversaria sta avendo un impatto significativo è nel sabotaggio digitale e nella manipolazione delle informazioni, due componenti chiave della moderna guerra cibernetica.

AI e disinformazione: l’uso di AI per generare notizie false, deepfake e campagne di disinformazione è diventato una tattica comune, abilitando operazioni mirate a destabilizzare l’opinione pubblica per seminare caos politico e sociale. La capacità dell’AI di produrre contenuti verosimili, come falsi video di leader politici che fanno dichiarazioni inesistenti, ha cambiato il modo in cui la propaganda digitale viene utilizzata nei conflitti globali.

Sabotaggio dei sistemi critici: l’AI viene utilizzata anche per identificare punti deboli nei sistemi critici, come le reti elettriche o le infrastrutture idriche. Sabotare questi sistemi può avere conseguenze catastrofiche, tra cui blackout su larga scala o interruzioni nelle forniture essenziali, arrivando a minare la stabilità economica e sociale di un Paese.

Il futuro del campo di battaglia: AI vs. AI

L’AI sta rapidamente trasformando il panorama della sicurezza informatica: tanto che gli esperti parlano di una vera e propria corsa agli armamenti, che include AI offensive e AI difensive.

Questo capitolo esplorerà come la lotta tra attaccanti che sfruttano l’intelligenza artificiale per lanciare attacchi e i difensori che la usano per contrastarli stia diventando una battaglia sempre più complessa e avanzata.

AI avversaria contro sistemi di difesa AI

L’intelligenza artificiale viene già ampiamente utilizzata per rilevare vulnerabilità e sviluppare strategie di attacco sempre più sofisticate.

Tramite l’AI gli attaccanti possono adattare le loro tecniche in tempo reale, esplorando rapidamente i punti deboli di sistemi difensivi avanzati: questo rende estremamente difficile, per gli strumenti difensivi basati sull’AI, anticipare gli attacchi e rispondere in modo efficace.

La difesa si trasforma in una partita di velocità e adattamento costante, poiché gli attacchi possono essere automatizzati e affinati rapidamente[6].

Ad esempio, tecniche come gli attacchi di evasione (che abbiamo analizzato in precedenza) stanno diventando sempre più diffuse.

Automazione difensiva: Anomaly Detection e risposta automatica

Sul fronte della difesa, gli sviluppi nell’Anomaly Detection stanno rendendo i sistemi di sicurezza più intelligenti e autonomi.

Utilizzando reti neurali profonde e algoritmi di apprendimento, i sistemi AI sono infatti capaci di analizzare enormi volumi di dati in tempo reale, individuando anomalie che potrebbero indicare un attacco. Ad esempio le difese AI sono ora in grado di rilevare schemi comportamentali insoliti e rispondere autonomamente, bloccando le attività sospette prima che possano arrecare danni significativi[7].

Tuttavia, c’è ancora una notevole disparità tra le capacità offensive e difensive dell’AI.

Gli attacchi basati sull’AI continuano ad avanzare più rapidamente rispetto alle difese, creando un divario tecnologico che mette a dura prova i team di cybersecurity in tutto il mondo; di conseguenza si richiede una collaborazione continua tra i ricercatori, i governi e le aziende per sviluppare contromisure innovative.

Verso un’AI etica nelle difese cibernetiche

Un concetto emergente è rappresentato dagli attacchi avversari etici (Ethical Adversarial Attacks), in cui gli esperti di sicurezza utilizzano tecniche simili agli attaccanti al fine di testare e rafforzare i sistemi difensivi.

L’idea è di impiegare gli stessi strumenti usati per attaccare i sistemi al fine di migliorarne la sicurezza, rispettando però limiti etici e legali[8].

Tale strategia non si discosta dall’ormai comune approccio dell’ethical hacking; per quanto efficace, richiede tuttavia ulteriori sforzi per poter colmare un gap che va ampliandosi sempre di più.

Implicazioni etiche e preoccupazioni

La diffusione del ricorso all’intelligenza artificiale nella guerra cibernetica solleva gravi preoccupazioni etiche: è infatti evidente come il potenziale dell’AI di automatizzare attacchi complessi e prendere decisioni senza supervisione umana metta in discussione il ruolo della responsabilità, sul piano sia morale che legale, di questi strumenti.

Il seguente capitolo esplorerà le principali questioni etiche derivanti dall’impiego dell’AI nelle operazioni cibernetiche e militari.

L’autonomia dell’AI nei conflitti cibernetici

Un tema cruciale riguarda il crescente uso di sistemi autonomi nelle operazioni cibernetiche militari.

La possibilità che l’AI prenda decisioni di attacco o difesa in modo autonomo solleva, com’è evidente, seri interrogativi etici: chi è responsabile quando un sistema autonomo causa danni non previsti o prende decisioni moralmente discutibili?

Tali preoccupazioni si amplificano quando si tratta di sistemi di armi autonome, poiché i decisori militari potrebbero essere tentati di delegare a una macchina decisioni di vita o di morte, così eliminando ogni responsabilità umana[9].

La disinformazione come arma: impatti socio-politici

Con la crescita dell’uso di tecnologie AI (come i già citati deepfake) per la creazione di campagne di disinformazione, la possibilità di manipolare l’opinione pubblica contribuisce a minare la fiducia nei processi democratici, oggi già vacillante in molte nazioni.

Il rischio che i deepfake vengano utilizzati per screditare rappresentanti delle istituzioni, destabilizzare governi o manipolare operazioni elettorali è concreto: ciò rende urgente ed essenziale affrontare queste sfide etiche tramite appropriate regolamentazioni[10].

Regolamentazione e legislazione internazionale

Per gestire gli effetti legati all’avanzata dell’Intelligenza Artificiale nel settore militare e cibernetico, diventa fondamentale stabilire quadri normativi a livello globale.

Tuttavia, raggiungere un consenso internazionale sulle misure da adottare per regolamentare l’uso dell’AI in guerra è complesso: paesi come Stati Uniti, Cina e Russia stanno sviluppando tecnologie AI per scopi militari e le discussioni su una possibile regolamentazione o messa al bando di queste armi non hanno ancora raggiunto risultati concreti.

Strategie difensive contro l’AI avversaria

Man mano che i sistemi di sicurezza informatica evolvono per affrontare le minacce emergenti, le difese contro l’AI avversaria stanno diventando sempre più sofisticate.

È infatti possibile adottare diversi approcci, sia tecnici sia metodologici, per rendere i sistemi AI più robusti contro attacchi mirati e adattivi.

Costruire sistemi AI resilienti

In questo campo, una delle principali sfide è rendere gli algoritmi di AI resistenti agli attacchi avversari.

Esistono diverse tecniche che possono rafforzare i sistemi AI.

- Addestramento avversario: questo processo comporta l’inserimento di esempi avversari nel set di addestramento dell’AI, in modo che il sistema impari a riconoscere e resistere a manipolazioni future. Aggiungendo dati che simulano attacchi, i modelli diventano più robusti contro le variazioni impreviste.

- Rafforzamento del modello: consiste nell’aggiornamento continuo dei modelli di AI per adattarsi a nuove minacce e migliorare la resistenza agli attacchi. Questo implica tecniche come la regolarizzazione per prevenire l’overfitting, che può rendere un modello vulnerabile a manipolazioni da parte di attori malevoli.

- AI spiegabile (XAI): implementare sistemi di AI “spiegabile” consente agli esseri umani di comprendere meglio il processo decisionale dei modelli AI, aumentando la fiducia nel sistema e facilitando l’identificazione delle vulnerabilità. In particolare, questo approccio aiuta a rilevare manipolazioni sottili nei dati di input che possono essere sfruttate dagli attaccanti.

Approcci ibridi umano-AI

Per quanto i sistemi di AI possano analizzare e reagire rapidamente a grandi quantità di dati, la combinazione di esperienza umana e potenza computazionale dell’AI rappresenta un vantaggio chiave nelle difese cibernetiche.

Gli esseri umani possono infatti rilevare sfumature e anomalie che potrebbero sfuggire all’AI, mentre la macchina può elaborare velocemente vasti dataset e suggerire azioni in tempo reale: l’approccio ibrido consente quindi una gestione più dinamica e resiliente delle minacce poiché, mentre l’AI identifica modelli di attacco su larga scala, l’esperienza umana valuta i rischi strategici e le risposte appropriate.

Intelligence proattiva sulle minacce

L’uso dell’AI per l’intelligence sulle minacce è diventato un pilastro fondamentale nella protezione contro gli attacchi.

Gli algoritmi di machine learning sono infatti in grado di analizzare grandi quantità di dati per prevedere attacchi futuri, consentendo di identificare eventuali vulnerabilità zero-day prima che vengano sfruttate dagli attaccanti.

I sistemi di AI possono scansionare continuamente reti e infrastrutture, identificando comportamenti anomali e prevedendo modelli di attacco: la capacità di prevedere e neutralizzare le minacce prima che si manifestino rende l’intelligence proattiva sulle minacce uno strumento fondamentale nella difesa contro gli attacchi avversari basati su AI.

Conclusioni

L’integrazione dell’intelligenza artificiale nel contesto della guerra cibernetica rappresenta un’autentica rivoluzione nel modo in cui affrontiamo le minacce informatiche.

Se da un lato l’AI offre potenti strumenti per difendere sistemi complessi e predire attacchi, dall’altro pone nuove sfide, soprattutto per quanto riguarda la sua vulnerabilità agli attacchi avversari e le implicazioni etiche del suo utilizzo nelle operazioni militari.

Le tecniche di difesa illustrate, come l’addestramento avversario e il rafforzamento dei modelli AI, mostrano il potenziale per rendere i sistemi più resilienti; ma è evidente che nessuna tecnologia è infallibile. L’approccio ibrido, combinando l’analisi dei dati su larga scala con il giudizio degli specialisti, si sta dimostrando una delle strategie più efficaci per bilanciare l’efficienza delle macchine con l’intuizione umana.

Inoltre, quando si considera l’automazione delle decisioni in ambito militare e cibernetico, gli aspetti etici diventano cruciali.

L’idea che un’intelligenza artificiale possa prendere decisioni fatali, o manipolare la realtà digitale allo scopo di influenzare l’opinione pubblica, solleva importanti domande sul grado di controllo umano che deve essere mantenuto. In tal senso, i sistemi di “AI spiegabile” e l’implementazione di regolamentazioni globali per limitare l’uso non etico dell’AI sono i primi passi verso la creazione di tecnologie più responsabili e sicure.

Nel futuro la vera sfida sarà mantenere il passo con l’evoluzione degli attacchi cibernetici alimentati dall’AI, sviluppando strumenti di difesa altrettanto avanzati senza trascurare i principi etici che devono guidare l’uso di queste tecnologie; per garantire che l’intelligenza artificiale sia utilizzata in modo responsabile e che le potenziali minacce siano gestite in modo efficace sarà fondamentale una costante collaborazione internazionale, insieme a una robusta regolamentazione di settore.

Va infine ricordato che, con l’arrivo imminente del quantum computing, le capacità dell’AI avversaria potrebbero vedere un boost degenerativo senza precedenti.

I computer quantistici promettono di risolvere problemi complessi a una velocità esponenzialmente superiore rispetto agli strumenti tradizionali, consentendo agli attaccanti di eseguire calcoli crittografici, analisi di grandi quantità di dati e simulazioni avanzate in tempi ridotti. Ciò significa che le AI avversarie, potenziate dal quantum computing, potranno facilmente violare crittografie oggi considerate sicure, scansionare e sfruttare vulnerabilità in infrastrutture IT/OT critiche e coordinare attacchi multi-vettore con un’efficienza senza pari.

Il risultato potrebbe essere una corsa agli armamenti tecnologica, dove le difese basate su AI dovranno evolvere a una velocità altrettanto rapida per tenere il passo delle minacce.

Senza soluzioni di sicurezza più robuste, la possibilità di destabilizzare interi settori a rilevanza critica (come quello dei trasporti autonomi o delle reti energetiche) diventerà un rischio concreto nel prossimo futuro, rendendo imperativa la ricerca non solo di nuove tecniche difensive ma anche di soluzioni etiche e regolatorie che sappiano prevenire il caos nel cyberspazio.

In definitiva, il ruolo dell’AI nella guerra cibernetica richiede una riflessione continua sul piano sia tecnologico che evolutivo.

Stiamo varcando una soglia in cui l’innovazione rischia di sfuggire al nostro controllo: la vera sfida non si limiterà allo sviluppo di strumenti sempre più potenti, imponendo altresì di comprendere come poter armonizzare progresso e sicurezza.

È una corsa contro noi stessi, dove il nostro destino digitale sarà scritto non dalla tecnologia che creiamo ma dalla capacità di comprenderne e di gestirne le implicazioni.

L’evoluzione dell’intelligenza artificiale nel panorama della sicurezza cibernetica è un argomento in continua evoluzione che richiede un monitoraggio costante e una comprensione approfondita delle sue implicazioni.

Per una trattazione più dettagliata e un’analisi tecnico-strategica completa di questi temi, ti invitiamo a consultare il Quaderni di Cyber Intelligence #7, dove potrai trovare ulteriori approfondimenti sui meccanismi dell’AI avversaria, case study aggiornati e le più recenti strategie difensive adottate a livello globale.

Articolo a cura di Alessio Garofalo – Technology Executive, Advisor, Autore e Futurista.

Note

[1]Cybercrime To Cost The World $10.5 Trillion Annually By 2025. Cybersecurity Ventures, 2020. AI-powered Malware and Polymorphic Attacks di Evans, A. e Robles, M., Journal of Cybersecurity

[2]AI-powered Malware and Polymorphic Attacks di Evans, A. e Robles, M., Journal of Cybersecurity Research, Vol. 15, 2022.

[3]Advanced Persistent Threats and AI: An Evolution in Cyber Warfare di Smith, J., International Journal of Information Security, Vol. 18, 2021.

[4]The Threat of Deepfake Technology in Cybersecurity di Patterson, B., Cybersecurity & Digital Forensics Review, Vol. 22, 2021

[5]Cyber Warfare and Artificial Intelligence: Emerging Threats to National Security di Thompson, R. e Hughes, K., Defense Technology Journal, Vol. 33, 2022.

[6]Bridging the AI Divide: The Evolving Arms Race Between AI-Driven Cyber Attacks and AI-Powered Cybersecurity Defenses, Waizel G., International Conference on Machine Intelligence & Security for Smart Cities, 2024.

[7]P&S Market Research. Artificial Intelligence (AI) in Cyber Security Market.

[8]The Double-Edged Sword of AI: Ethical Adversarial Attacks. di Springer A. AI and Ethics, 2021.

[9]Schwarz E., “The Ethical Implications of AI in Warfare.” Queen Mary University of London, 2020.

[10]Morgan F., Boudreaux B., Lohn A. et al. “Military Applications of Artificial Intelligence: Ethical Concerns in an Uncertain World”, RAND Corporation, 2020.

Executive nel settore tecnologico con solide

radici nella Difesa e una carriera internazionale

che include ruoli chiave in Amazon e NEOM. Attualmente CIO/CTO di Oxagon, guida l’innovazione per la città industriale del futuro. Alessio è anche advisor per diverse realtà, autore di due libri e imprenditore attivo, focalizzato sulla creazione di prodotti digitali attraverso un venture studio.

https://www.ictsecuritymagazine.com/articoli/ai-avversaria/

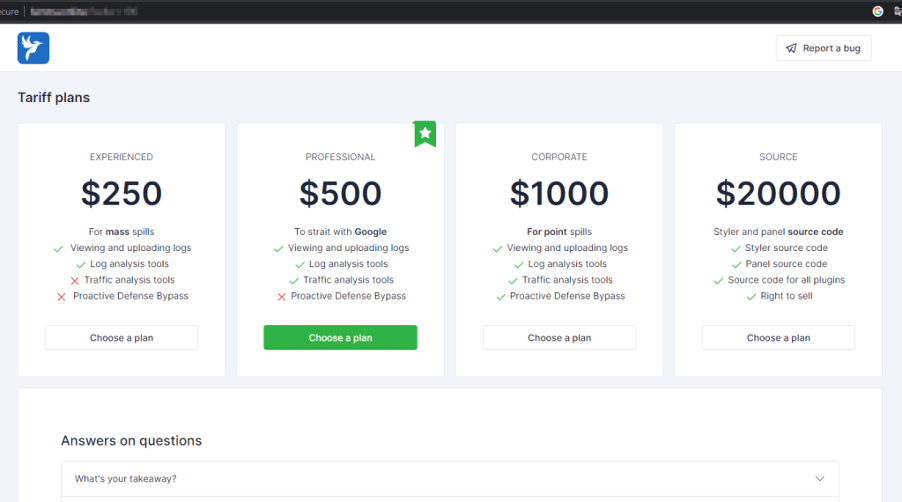

L’offerta commerciale includeva piani di abbonamento mensili compresi tra 250 e 1.000 dollari, con la possibilità di acquistare l’accesso al codice sorgente per 20.000 dollari. Per facilitare l’utilizzo anche da parte di attori meno esperti, il gruppo aveva pubblicato una documentazione tecnica dettagliata su Gitbook, accessibile tramite un sito web dedicato collegato al progetto.

L’offerta commerciale includeva piani di abbonamento mensili compresi tra 250 e 1.000 dollari, con la possibilità di acquistare l’accesso al codice sorgente per 20.000 dollari. Per facilitare l’utilizzo anche da parte di attori meno esperti, il gruppo aveva pubblicato una documentazione tecnica dettagliata su Gitbook, accessibile tramite un sito web dedicato collegato al progetto.